美团短视频场景下视觉AI技术的应用与视频内容优化策略

一、背景

美团围绕丰富的本地生活服务电商场景积累了丰富的视频数据。

美团场景短视频示例

上图展示了美团业务场景中的菜品点评示例。可见,视频能够提供比文字和图像更丰富的信息。创意菜品《冰与火之歌》中火焰、巧克力和冰淇淋的动态互动以短视频的形式呈现得淋漓尽致,从而为商家为用户提供多元化的内容展示和消费引导。

视频产业发展

我们之所以能够快速进入视频爆炸时代,是因为很多技术领域都取得了显着的进步,包括拍摄采集设备的小型化、视频编解码技术的进步、网络通信技术的完善等。近年来,随着视觉AI算法不断成熟,在视频场景中得到广泛应用。本文将重点探讨如何通过视觉AI技术的支持,提高视频内容创作、制作和分发的效率。

美团AI——场景驱动技术

说起美团,大家首先想到的就是叫外卖。不过,除了外卖,美团还有其他200多项业务,涵盖“吃”“住”“行”“玩”等生活。服务场景,以及“美团精选”、“团好号”等零售电商公司。丰富的业务场景带来多样化的数据和多样化的实际应用,从而驱动底层技术的创新迭代。同时,底层技术的积累可以赋能各业务的数字化、智能化升级,形成相互促进的良性循环。

美团商业场景短视频

丰富的内容和展示形式(C端)

本文分享的一些技术实践案例主要围绕“吃”展开。美团在各个场景站点都有内容布局和展示形式。短视频技术在美团C端也有丰富的应用,比如:首页推流视频卡、沉浸式视频、打开大众点评App看到的视频等。笔记、用户评论、搜索结果页面等。这些视频内容首先要经过众多算法模型的理解和处理,然后才能呈现给用户。

丰富的内容和展示形式(B面)

商户端(B端)的视频内容展示形式包括景点介绍——让消费者在线体验更加立体的旅行体验;酒店相册快览——将相册中的静态图片组合成视频,全面展示酒店。帮助用户快速了解整个酒店的信息(自动生成技术将在下面2.2.2章节介绍);商家品牌广告——算法通过智能编辑等功能,降低商家编辑、制作视频的门槛;商户视频相册——商户可以自行上传各种视频内容,算法对视频进行标签,帮助商户管理视频;产品视频/动画——如上所述,美团的业务范围还包括零售电商,这对于展示产品信息非常有利。例如,螃蟹、虾等生鲜产品的运动信息很难通过静态图像呈现,但动画图像可以为用户提供更多的产品参考信息。

短视频技术应用场景

从应用场景来看,短视频的线上应用主要包括:内容运营管理、内容搜索推荐、广告营销、创意制作等。底层支撑技术主要可以分为两类:内容理解和内容生产。内容理解主要回答视频中的什么时间点以及出现什么样的内容的问题。内容制作通常基于对视频素材的内容理解和处理。典型的技术包括智能视频封面和智能编辑。下面我将介绍这两类技术在美团场景中的实践。

2. 短视频内容理解与生成技术实践 2.1 短视频内容理解 2.1.1 视频标签

视频内容理解的主要目标是总结视频中出现的重要概念,打开视频内容的“黑匣子”,让机器知道盒子里有什么,为下游应用程序更好地管理和提供语义信息。分发视频。 。根据结果的形式,内容理解可以分为两种类型:显式和隐式。其中,显式是指利用视频分类相关技术,为视频打上人类可以理解的文本标签。隐式主要是指以向量形式表达的嵌入特征,与推荐、搜索等场景中的模型相结合,直接对最终任务进行建模。大致可以理解为,前者主要面向人,后者主要面向机器学习算法。

显式的视频内容标签在很多场景下都是必要的,比如内容运营场景。运营商需要基于标签进行供需分析、高价值内容筛选等。上图展示了通过内容理解来给视频打标签的总结过程。这里的每一个标签都是一个人们能够理解的关键词。通常,为了更好的维护和使用,大量的标签根据它们之间的逻辑关系被组织成一个标签系统。

2.1.2 视频标签的不同维度和粒度

那么视频标签的应用场景有哪些呢?其背后有何技术难点?美团场景中比较有代表性的例子就是食品店探索视频,内容非常丰富。标签系统的设置尤为关键。什么样的标签更适合描述视频内容?

首先,标签的定义需要从产品、运营、算法的角度最终确定。在这种情况下,存在三个级别的标签,较高级别变得更加抽象。其中,主题标签对整体视频内容有很强的概括能力,例如食品店主题;中间层将进一步拆分,描述与拍摄场景相关的内容,例如店内、店外环境;最底层被分成细粒度的实体来理解从宫保鸡丁到番茄炒蛋。不同级别的标签有不同的应用。顶级视频主题标签可用于高价值内容的过滤和运营方式。它的主要困难在于它的高度抽象。 “美食探索”这个词很笼统,看完视频就能明白。然而,从视觉特征建模的角度来看,需要哪些特征才能被视为食物探索呢?对模型的学习能力提出了更大的挑战。

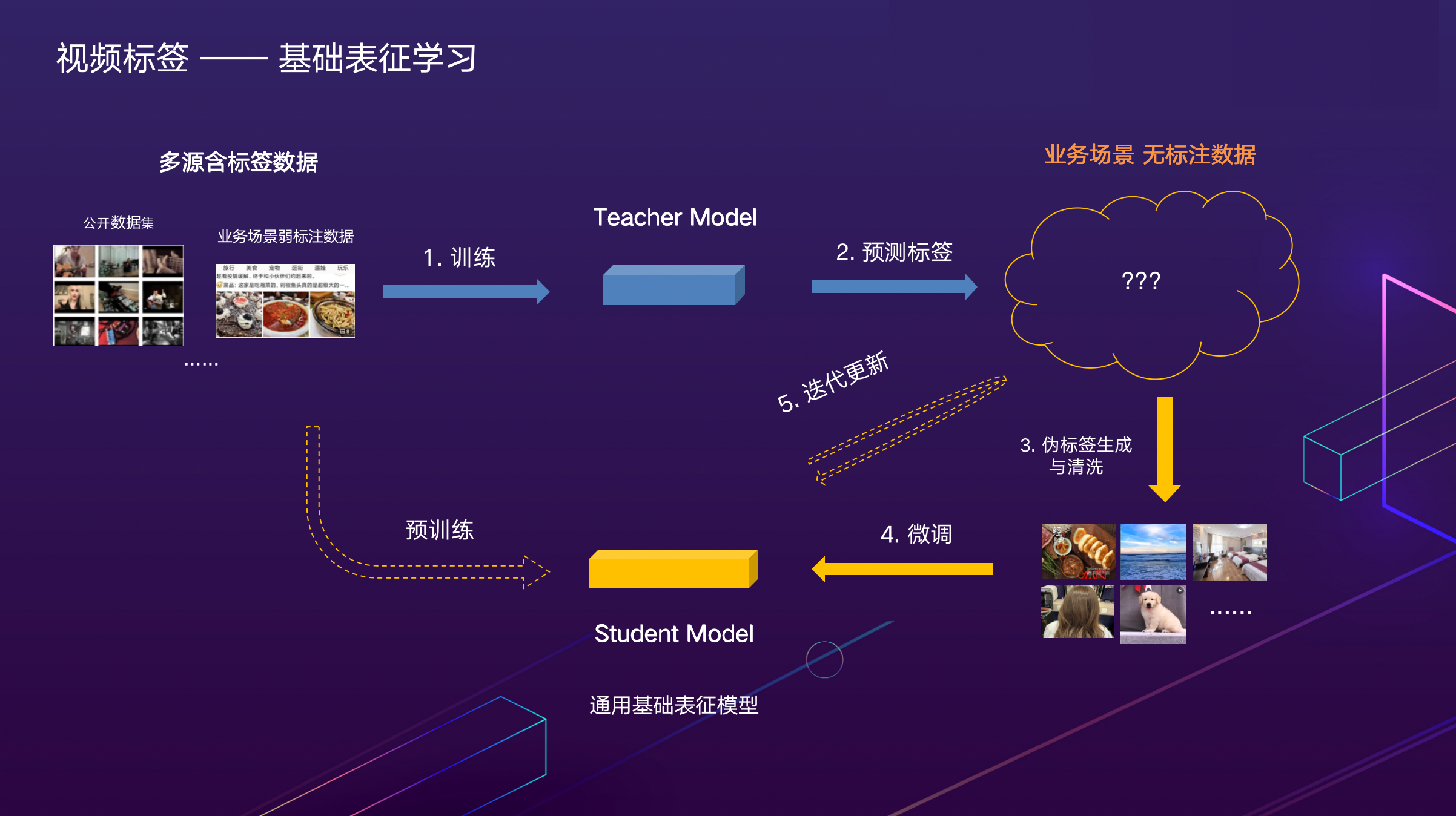

2.1.3 基本表示学习

该解决方案主要集中在两个方面:一方面是独立于标签的通用基本表示的改进,另一方面是针对特定标签的分类性能的改进。初始模型需要具有比较好的基础表示能力。这部分不涉及最终的下游任务(例如:识别是否是食品店视频),而是模型权重的预训练。良好的基础表示可以提高下游任务的性能,事半功倍。

由于视频标签的标注成本非常高,因此在技术方案层面需要考虑的是:如何在尽可能少地使用业务全监督标注数据的同时,学习到更好的基础特征。首先,在任务无关的基础模型表示层面,我们在美团视频数据上使用自监督预训练特征,比公共数据集上的预训练模型更符合业务数据分布。

其次,在语义信息嵌入层面(如上图所示),可以利用的标记数据来源有多种。值得一提的是,美团独有的业务场景弱标注数据,例如:用户评论一家餐厅时,图片和视频上的抽象标签是食物,而评论文字很可能会具体提到他在店里吃了什么。菜名是可以通过视觉文本相关性度量等技术手段挖掘、清洗的优质监管信息。这里显示的是自动挖掘的标记为“烧烤”的视频样本。

利用这部分数据进行预训练,可以得到一个初始的Teacher Model,为业务场景的无标签数据添加伪标签。这里关键是,由于预测结果并不完全准确,需要根据分类置信度等信息进行伪标签清洗,然后获取增量数据,与Teacher Model一起使用,在业务中表达更好的特征场景,进行迭代清洗,得到Student Model。充当下游任务的底层表示模型。在实践中,我们发现数据迭代比模型结构改进有更大的好处。

2.1.4 模型迭代

针对特定标签的性能提升的主要问题是如何在基本表示模型的基础上高效地迭代目标类别的样本数据,以提高标签分类模型的性能。样本的迭代分为离线和在线两部分。以食品店标注为例,需要先对少量正样本进行离线标注,并对基本表示模型进行微调,得到初始分类模型。此时模型的识别准确率通常较低,但即便如此,对于样本清理和迭代还是有帮助的。想象一下,如果标注者漫无目的地从库存样本池中筛选,在观看数百或数千个视频后可能很难找到目标类别的样本。不过通过初始模型的预筛选,看几个视频就可以完成。筛选出目标样本可显着提高标记效率。

第二步是如何继续迭代更多的在线样本,提高标签分类模型的准确率。我们的模型在线预测结果分为两个返回路径。如果在线模型预测结果非常有信心,或者多个模型认知一致,则模型预测标签可以自动回流并添加到模型训练中。对于置信度高但错误的噪声标签,可以在模型训练过程中使用一些抗噪声技术,例如:置信度学习进行自动消除。更有价值的是,在实践中,我们发现通过手动修正模型的不置信度数据,模型性能提升ROI更高。例如,筛选出三个模型预测结果差异较大的样本,交给人工确认。这种主动学习方法可以避免在大量简单样本上浪费标注人力,扩展对提高模型性能更有价值的标注数据。

2.1.5 视频主题标签应用——高价值内容筛选与聚合

上图是视觉主题标签在大众点评推荐业务中的应用案例。最具代表性的就是高价值内容的选择:在大众点评App首页信息流的专家店选项卡中,运营同学筛选出“食品店”标签的视频进行展示。在沉浸式的体验中更全面地了解店内信息,同时也为商家宣传、吸引流量提供了良好的窗口。

2.1.6 视频标签的不同维度和粒度

从上图可以看出,不同尺寸的标签有不同的技术要求。其中,细粒度的实体理解需要识别出具体是哪道菜。这与上层粗粒度标签的问题不同,需要考虑如何应对技术挑战。第一个是细粒度的识别任务,需要对视觉特征进行更精确的建模;其次,视频中菜肴的理解比单幅图像中菜肴的识别更具挑战性,需要处理数据的跨领域问题。

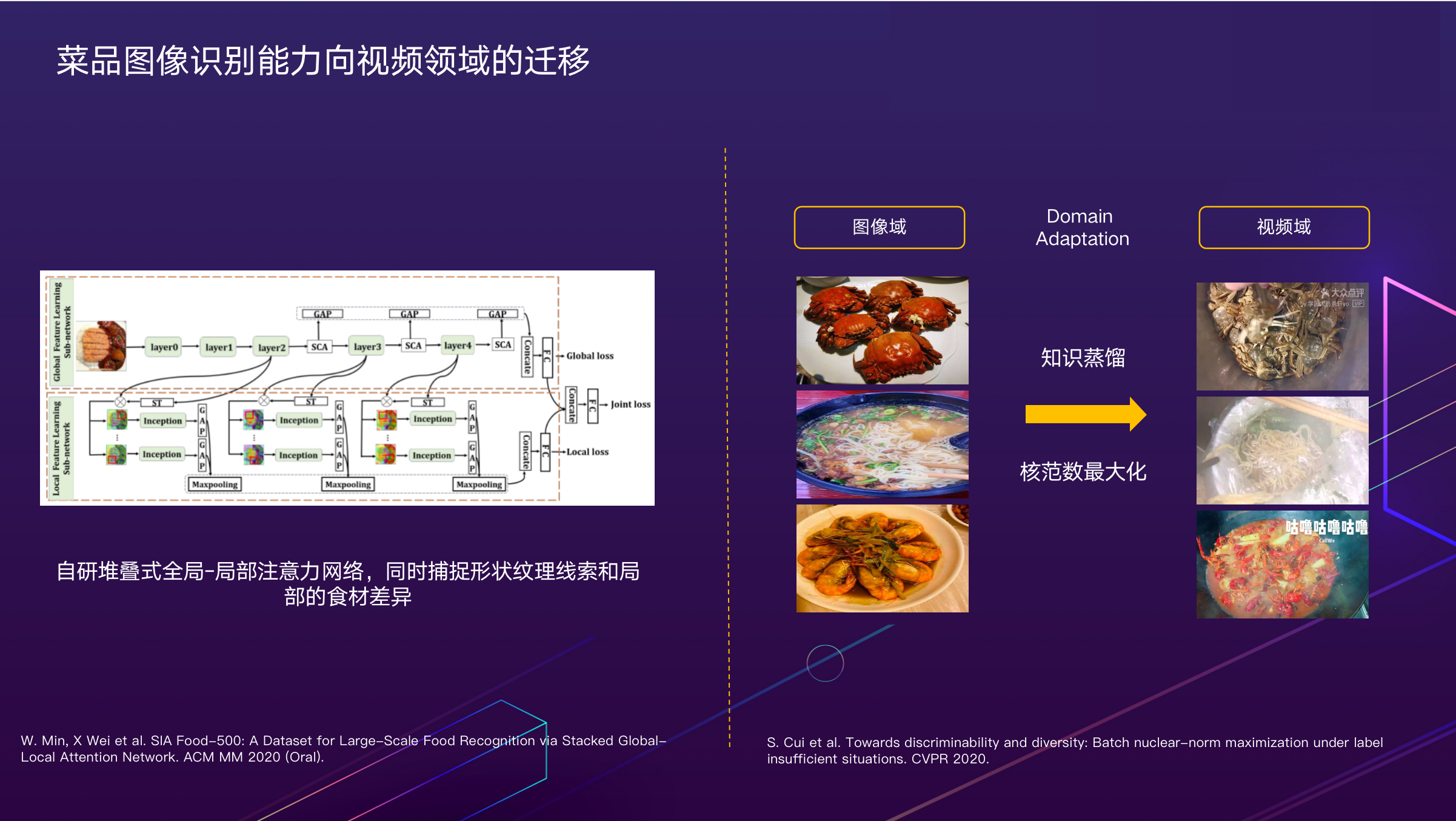

2.1.7 菜品图像识别能力向视频领域迁移

抽象出关键问题后,我们将分别进行处理。首先,关于细粒度识别问题,衡量菜肴视觉相似度的挑战在于,不同食材的特征和位置关系没有标准化的定义。不同的厨师可能会用两种完全不同的方法来制作同一道菜。这就需要一个既能关注局部细粒度特征,又能整合全局信息进行判别的模型。为了解决这个问题,我们提出了一个堆叠的全局局部注意力网络,它同时捕获形状纹理线索和局部成分差异,显着提高了菜肴识别效果。相关成果发表在ACM MM国际会议上(ISIA Food -500: A Dataset for Large-Scale Food Recognition via Stacked Global-Local Attention Network)。

上图 ( ) 是挑战的第二部分。图像和视频帧中的相同对象通常具有不同的外观。例如:图片中的螃蟹经常被煮熟并放在盘子里,而烹饪过程中的活螃蟹经常出现在视频帧中。它们在视觉上是不同的。很大。我们主要从数据分布的角度来处理这些跨域差异。

业务场景积累了大量带注释的美食图片。这些样本的预测结果的区分度通常都很好。然而,由于数据分布的差异,无法高置信度地预测视频帧中的螃蟹。对此,我们希望提高视频帧场景中预测结果的辨别力。一方面,采用最大化核范数的方法来获得更好的预测分布。另一方面,利用知识蒸馏,通过强大的模型不断指导轻量级网络的预测。结合视频帧数据的半自动标注,在视频场景下可以获得更好的性能。

2.1.8 细粒度菜肴图像识别能力

基于以上对美食场景内容理解的积累,我们在ICCV2021举办了大规模细粒度食物分析竞赛。菜品图片来源于美团实际业务场景,包含1500种中餐菜品。竞赛数据集持续开放,欢迎大家下载使用,共同提高挑战性场景下的识别性能。

2.1.9 菜品细粒度标签应用——按搜索封面

识别视频中细粒度菜名有哪些应用?这里我给大家分享一个评论搜索业务场景的应用——按搜索封面。达到的效果是根据用户输入的搜索关键词,对同一套视频内容显示不同的封面。图中离线部分展示了对视频片段进行分割和优化的过程。首先,通过关键帧提取和基本质量过滤来选择适合显示的图片;然后,通过对菜肴的细粒度标签识别,我们了解哪些菜肴在哪些时间点出现,作为候选封面材料存储在数据库中。

当在线用户搜索感兴趣的内容时,根据视频的多个候选封面与用户查询词之间的相关性,向用户显示最合适的封面,以提高搜索体验。

例如搜索“火锅”时,左图为默认封面,右图为“按搜索封面”的结果。可以看到,左侧结果存在一些以人为主体的封面,与用户搜索火锅视频时期望看到的内容不一致。直观上感觉像是不相关的坏案例。在搜索封面展示结果时,搜索到的内容均为火锅图片,体验较好。这也是美团场景下视频片段细粒度标签理解的创新应用。

2.1.10 挖掘更丰富的视频片段标签

以上都是以美食视频为主,但美团还有很多其他的业务场景。如何自动挖掘更丰富的视频标签,让标签系统本身能够自动扩展,而不是完全依赖人工定义,是一个重要的课题。我们基于大众点评丰富的用户评论数据开展相关工作。上图中的示例是用户的注释。您可以看到内容包含视频和几张图片,以及大量的描述。这些模式是相关的并且具有共同的概念。通过一些统计学习方法以及视觉和文本模态之间的交叉验证,可以挖掘视频剪辑和标签之间的对应关系。

2.1.11 视频片段语义标签挖掘结果示例

例如,视频片段和标签是通过算法自动挖掘的。左图为标签出现频率,呈现明显的长尾分布。但值得注意的是,通过这种方式,算法可以发现更细粒度的有意义的标签,例如“围巾画”。这样可以在最大限度减少人工参与的同时,发现美团场景中更重要的标签。

2.2 短视频内容生成

接下来我们来说说如何基于内容理解来生产内容。内容制作是短视频AI应用场景中非常重要的一环。下面的分享更多涉及到视频素材的解构和理解。

视频内容制作的流程环节(如上图所示),其中内容生成环节主要是将原始视频上传到云端,作为素材通过算法进行编辑处理,更好地发挥视频的潜在价值内容。例如,在广告场景中,通过算法识别并剪辑出原始视频中展示商业环境和菜肴效果的亮点,提高信息的密度和质量。

此外,视频内容制作按照应用形式可以分为三类:

图片生成视频,常见形式包括自动生成相册预览视频;视频生成视频片段,典型案例是将长视频的精彩片段剪辑成更精简的短视频进行二次分发;视频像素级编辑,主要涉及细化画面效果编辑。

下面,我们将解释这三种类型的申请表。

2.2.1 图像生成视频——就餐场景中食物动画的生成

第一类是图像生成的视频。这部分要做的更多的是对图像素材的理解和处理,让用户无需了解技术细节,就能一键端到端生成理想的素材。如上图所示,商家只需输入生产素材的图片相册,一切都交给AI算法:首先,算法会自动剔除拍摄质量较差、不适合展示的图片;然后它将执行内容识别和质量分析。内容识别包括内容标签,质量分析包括清晰度和美感评分;由于原始图像素材的尺寸难以直接贴合目标展位,需要根据审美评价模型对图像进行智能裁剪;最后,Ken-Burns和转场叠加等特效,得到渲染结果。商家可以获得精美的美食视频。

2.2.2 图片生成视频-酒店场景相册快看视频生成

还有一个在酒店场景生成相册预览视频的例子。与动画图像相比,它需要结合音频和过渡效果。同时,视频对于首先展示什么样的内容也提出了更高的要求。需要结合业务场景的特点,根据设计者制定的脚本模板,算法可以自动过滤特定类型的图像并将其填充到模板的相应位置。

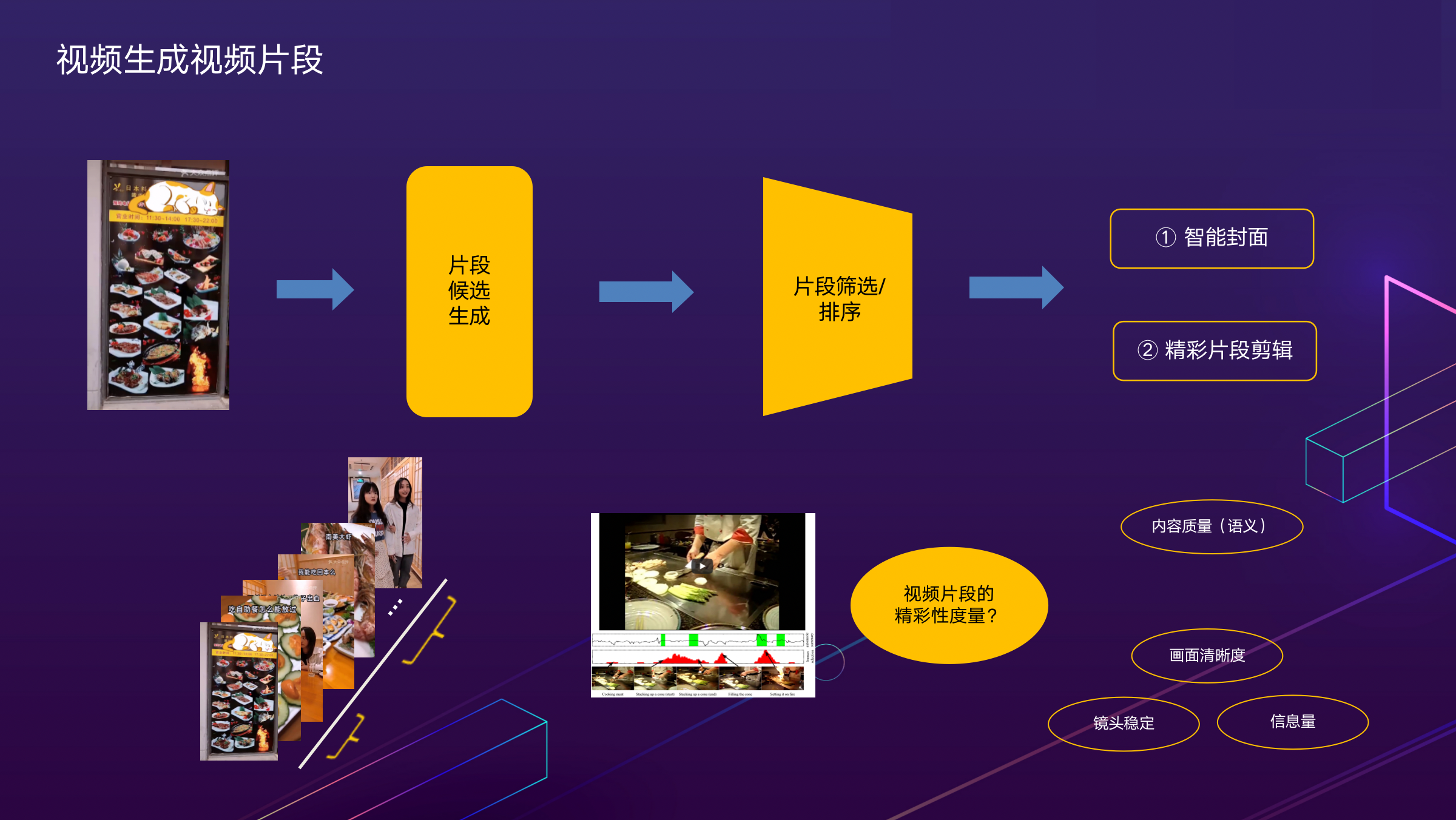

2.2.3 Video生成视频剪辑

第二类,视频生成视频剪辑。主要目的是对长视频进行分割,选择几个比较精彩、符合用户期望的内容进行展示。算法阶段分为片段生成和片段筛选排序。在片段生成部分,通过时序分割算法获得镜头片段和关键帧。剪辑排序部分比较关键,它决定了视频的优先级。这也是最难的部分,它有两个维度:

一般质量维度包括清晰度和美观度;语义维度,比如美食视频中,菜肴成品的展示和制作过程通常都是令人兴奋的片段。语义维度的理解主要由前面介绍的内容理解模型支撑。

2.2.3.1 智能封面和亮点

原版封面-1

原版封面-2

算法生成 cover-1

算法生成 cover-2

原始视频

算法编辑视频(10s)

我们从视频生成视频片段来实现两个应用场景。一是智能动态封面,主要在一般基础质量的基础上,选择清晰度较高、动态信息丰富、无闪烁、滞后的视频片段作为视频的封面。与默认剪辑相比,效果更好。

2.2.4 视频像素级编辑处理——菜品视频特效

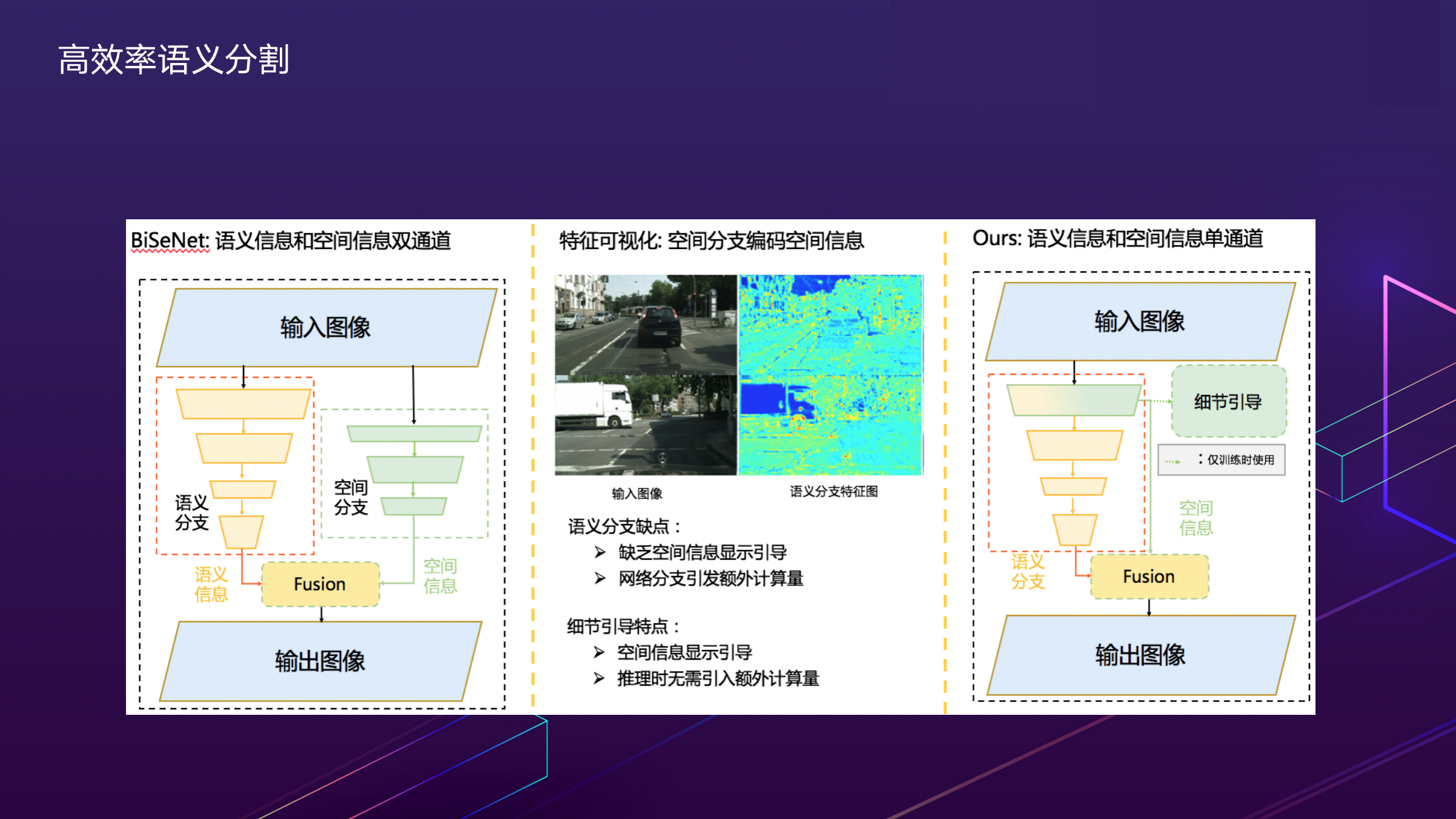

第三类是视频像素级编辑。例如,这里有一个基于视频对象分割(VOS)技术的创意菜肴特效。其背后的关键技术是美团自主研发的高效语义分割方法。该方法已经发表在CVPR 2022(Rethinking BiSeNet For Real-time Semantic Segmentation)上,有兴趣的同学可以详细了解。

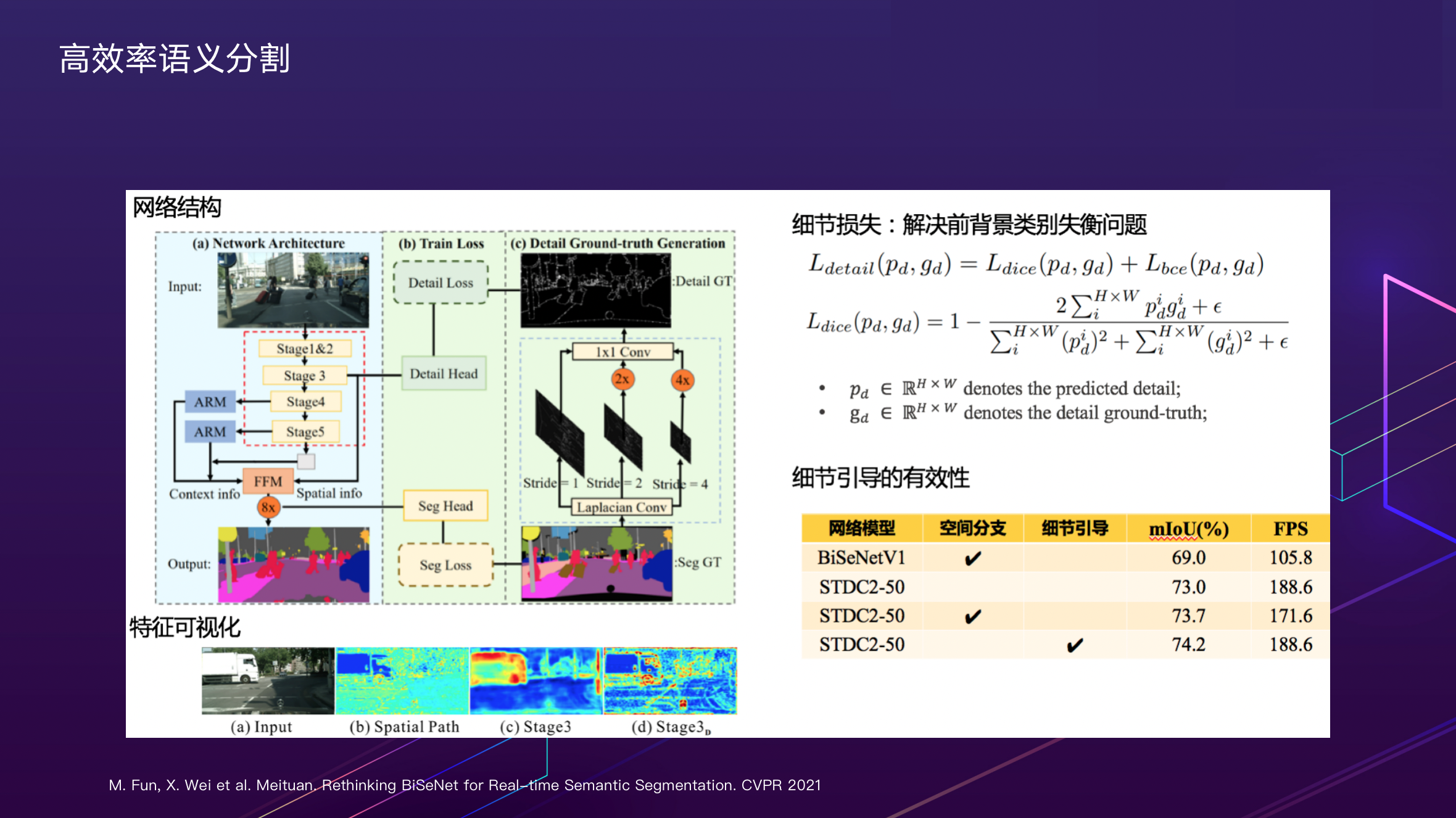

像素级编辑处理最重要的技术之一是语义分割。应用场景面临的主要技术挑战是保证分割模型的时效性,同时还要保证分辨率并保持高频详细信息。我们进一步改进了经典的 BiSeNet 方法,提出了一种基于细节引导的高效语义分割方法。

具体方法如网络结构所示。左侧浅蓝色部分是网络的推理框架,遵循BiSeNet Context分支的设计。 Context分支的主干使用我们自主开发的主干STDCNet。与BiSeNet不同的是,我们在Stage3上进行了细节引导训练,如右图浅绿色部分所示,引导Stage3学习细节特征;浅绿色部分只参与训练,不参与模型推理,因此不会造成额外时间。消耗。首先,对于分割的groundtruth,我们使用不同步长的拉普拉斯卷积来获得细节真值,丰富图像边缘和角点信息;然后,我们使用细节真值和设计的细节损失来指导Stage3细节特征的浅层特征学习。

由于图像真实值前后的背景细节分布严重不平衡,我们采用了DICE损失和BCE损失的联合训练方法。为了验证详细指导的有效性,我们进行了这个实验。从特征可视化的结果中,我们可以看到通过在多个尺度上获得的详细真实值来指导网络可以获得最好的结果。详细的信息指导也提高了模型的性能。

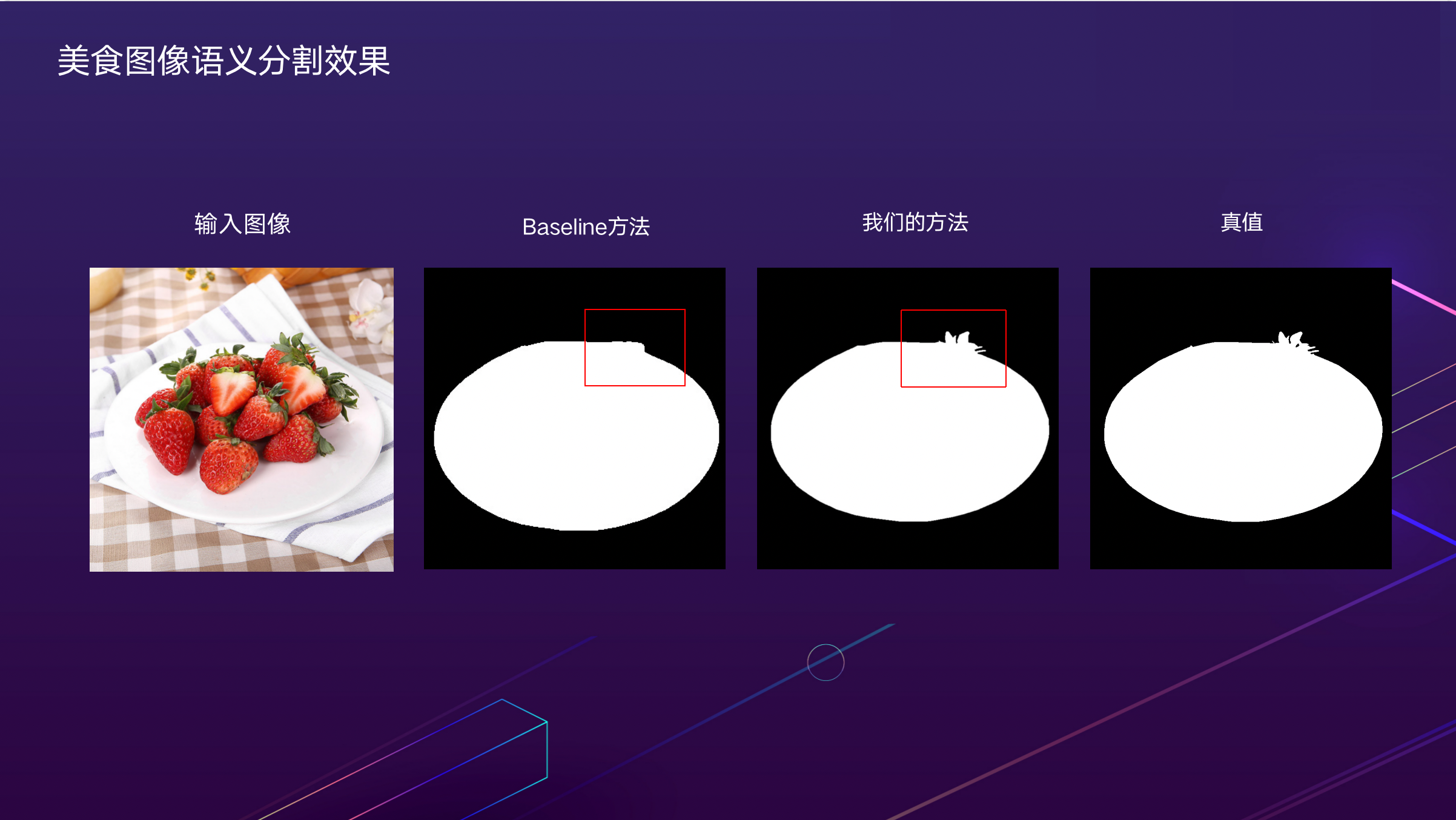

从效果上看,通过对比可以看出,我们的方法在保持分割细节的高频信息方面具有很大的优势。

三、总结与展望

上文曾分享过,美团在视频标签、视频封面与编辑、视频细粒度像素级编辑等技术领域,有望结合业务场景,为商家和用户提供更加智能的信息展示和获取方式。未来,短视频技术的应用将在美团丰富的业务场景中,包括本地生活服务、零售电商等,具有更大的潜在价值。在视频理解技术方面,多模态自监督训练对于缓解对标注数据的依赖、提高模型在复杂业务场景下的泛化性能非常有价值。我们也在做一些尝试和探索。

从:

Hadoop YARN:调度性能优化实践 - 美团技术团队

Guava效率提升工具库日常开发核心实用指南_guava串列列表-CSDN博客

界面性能优化指南:解决性能瓶颈的策略与实践_前端网站页面构建-CSDN博客

Guava效率提升工具库日常开发核心实用指南_guava串列列表-CSDN博客